LLM 整合 RAG 技術的核心挑戰與突破方向

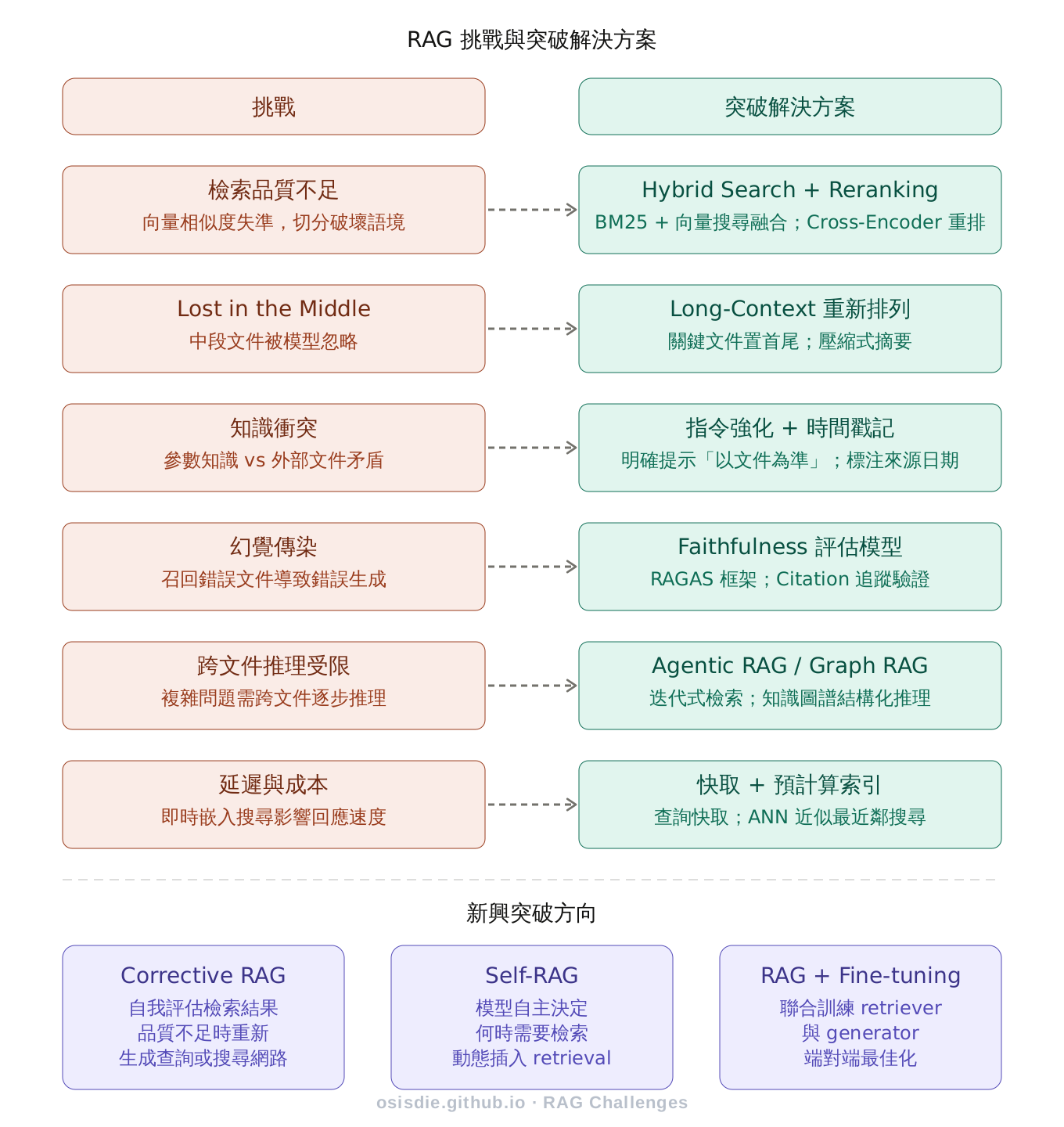

English Abstract — As RAG (Retrieval-Augmented Generation) moves from proof-of-concept to production in 2026, six core challenges have emerged: retrieval quality gaps, the “Lost in the Middle” attention problem, knowledge conflicts between retrieved documents and parametric memory, hallucination propagation from bad retrievals, inability to perform multi-hop reasoning, and latency/cost at scale. This article examines each challenge and maps them to four breakthrough solutions: Hybrid Search + Reranking, Agentic RAG / Graph RAG, Self-RAG, and the RAGAS evaluation framework — with pseudocode examples and production considerations.

2026 年生產環境中,RAG 不再是「加分項」,而是「必備項」— 但多數團隊仍在踩雷。本文全面分析 RAG 面臨的六大核心挑戰與四大突破方向,附帶 pseudocode 與實戰注意事項。

核心挑戰

1. 檢索品質的瓶頸

RAG 的效果高度依賴「找得到」的前提。傳統向量相似度搜尋(cosine similarity)在語意模糊或多義詞情境下容易失準,例如查詢「蘋果市值」時可能同時召回水果和科技公司的文件。此外,文件切分(chunking)策略若處理不當,同一個概念被切斷後,單獨的 chunk 會失去上下文意義。→ 這正是 Hybrid Search + Reranking 要解決的問題。

2. 知識整合的挑戰(Lost in the Middle)

研究顯示,當 LLM 的 context window 塞入大量 retrieved 文件時,模型對位於中間位置的文件注意力顯著下降,容易忽略關鍵資訊。這個問題在 context 超過 4k token 時尤為明顯。→ 解法是 Long-Context 重新排列與壓縮式摘要。

3. 知識衝突(Knowledge Conflict)

外部檢索到的文件與 LLM 本身的參數知識(parametric knowledge)可能互相矛盾。例如模型訓練時學到「X 是 CEO」,但最新文件顯示已換人,模型可能固執地相信自己的舊知識。→ 需要指令強化明確提示「以文件為準」。

4. 幻覺傳染(Hallucination Propagation)

若 retriever 召回了錯誤或無關文件,LLM 傾向於「信任」並據此生成,反而比不做 RAG 更糟,因為模型會把錯誤資訊包裝成有根據的回答。→ Faithfulness 評估模型與 RAGAS 框架能有效偵測這個問題。

5. 跨文件推理受限(Multi-hop Reasoning)

複雜問題需要跨多份文件進行推理(A → B → C),但標準 RAG 是「一次性」檢索,無法像人類一樣逐步找到中間線索再繼續深挖。→ Agentic RAG 與 Graph RAG 正是為此而生。

6. 延遲與成本

每次請求需要即時做 embedding 搜尋、重排序(reranking),加上 LLM 推理,整體延遲在生產環境中是顯著挑戰。→ 透過快取 + 預計算索引可有效緩解。

深入解析:突破解決方案

Hybrid Search + Reranking

結合稀疏檢索(BM25,擅長精確關鍵字匹配)與稠密向量檢索,再透過 Cross-Encoder 做二次排序。這種兩階段架構(召回 100 篇 → 精排 top-5)大幅提升最終送入 LLM 的文件品質,是目前業界主流作法。

# Hybrid Search + Reranking pseudocode

bm25_results = bm25_search(query, top_k=50)

vector_results = vector_search(embed(query), top_k=50)

# Reciprocal Rank Fusion

candidates = rrf_merge(bm25_results, vector_results, k=60)

# Cross-Encoder reranking

scored = cross_encoder.predict([(query, doc) for doc in candidates])

top_docs = sorted(scored, reverse=True)[:5]

Production Notes — Cross-Encoder reranking 延遲約 50-200ms(取決於模型大小)。可用輕量 reranker(如

bge-reranker-v2-m3)在 <50ms 完成。召回階段用 ANN 近似搜尋(HNSW)而非暴力搜尋以降低 p99 延遲。

Agentic RAG 與 Graph RAG

Agentic RAG 讓 LLM 作為 agent,根據前一次檢索的結果決定下一個查詢,支援跨文件多步推理。Graph RAG(Microsoft 2024 年提出)則將知識以圖結構儲存,能捕捉實體間的關係,對「比較型」和「概念聯結型」問題效果顯著優於傳統向量 RAG。

# Agentic RAG pseudocode — iterative retrieval loop

context = []

for step in range(MAX_ITERATIONS): # guard: prevent infinite loops

action = llm.decide(query, context) # "search" | "answer" | "refine"

if action == "answer":

return llm.generate(query, context)

elif action == "search":

new_query = llm.rewrite_query(query, context)

docs = retriever.search(new_query)

context.extend(docs)

elif action == "refine":

query = llm.decompose(query) # break into sub-questions

Production Notes — 務必設定

MAX_ITERATIONS(建議 3-5),避免 agent 陷入無限循環。每輪迭代的 token 消耗會累積,需監控成本。Graph RAG 的建圖成本高(indexing 階段),但查詢階段效率與向量 RAG 相當。

Self-RAG

這是一個較根本的架構改變:模型學會在生成過程中自行插入特殊 token,決定「現在需不需要檢索」、「這段生成是否有文件支持」,把檢索決策內化到模型本身,而非外部固定流程。

# Self-RAG — model generates special tokens during inference

output_tokens = []

for segment in generate_segments(query):

# Model outputs a retrieval decision token

if segment.retrieval_token == "[Retrieve=Yes]":

docs = retriever.search(segment.text)

segment = regenerate_with_context(segment, docs)

# Model self-evaluates with support token

if segment.support_token == "[Fully Supported]":

output_tokens.append(segment)

elif segment.support_token == "[No Support]":

output_tokens.append(flag_as_uncertain(segment))

Production Notes — Self-RAG 需要專門微調的模型(原論文使用 Llama 2 微調)。推論延遲比標準 RAG 高約 1.5-2x,因為需要多次生成 + 評估。適合高精度場景(醫療、法律),不適合低延遲需求。

RAGAS 評估框架

RAG 系統的評估一直是痛點。RAGAS 提供了四個維度的自動化評估:

- Faithfulness – 生成是否忠實於文件

- Answer Relevancy – 答案是否回答問題

- Context Recall – 需要的資訊是否被召回

- Context Precision – 召回的文件是否相關

# RAGAS evaluation pseudocode

for question, ground_truth in eval_dataset:

contexts = retriever.search(question)

answer = llm.generate(question, contexts)

scores = {

"faithfulness": ragas.faithfulness(answer, contexts),

"answer_relevancy": ragas.relevancy(answer, question),

"context_recall": ragas.recall(contexts, ground_truth),

"context_precision": ragas.precision(contexts, question),

}

# Aggregate scores to track system improvements over time

Production Notes — RAGAS 本身使用 LLM 做評估(LLM-as-judge),因此評估成本與被評估系統的推論成本相當。建議在 CI/CD 中對 golden dataset(50-100 筆)跑 RAGAS,設定 threshold 作為品質門檻。

有了可量化的指標,系統改進才有方向。

總結趨勢

目前領域的方向是從「靜態一次性檢索」走向「動態、自反式、多輪」的架構。Long Context 模型的崛起(如 Gemini 1.5 Pro 的 1M token window)讓部分人質疑 RAG 是否仍有必要,但實際上 RAG 的價值在於知識的可更新性與可溯源性,而非只是解決 context 長度問題,這是純粹增大 context window 無法取代的。兩者更可能是互補而非替代關係。

References

- Lost in the Middle — Liu et al., 2023. Lost in the Middle: How Language Models Use Long Contexts

- Graph RAG — Microsoft, 2024. From Local to Global: A Graph RAG Approach · GitHub

- Self-RAG — Asai et al., 2023. Self-RAG: Learning to Retrieve, Generate, and Critique

- RAGAS — GitHub · Documentation

- Corrective RAG — Yan et al., 2024. Corrective Retrieval Augmented Generation

Recommended Repos

- microsoft/graphrag — Production-ready Graph RAG implementation

- explodinggradients/ragas — RAG evaluation framework

- run-llama/llama_index — Full-featured RAG framework

- langchain-ai/langchain — LLM application framework with RAG support

Source: osisdie/osisdie.github.io — PRs and Issues welcome!

Enjoy Reading This Article?

Here are some more articles you might like to read next: